一、AI既不是魔鬼也不是神器,而是一种工具

不是魔鬼

- AI本身并没有恶意。它是由人类开发的技术成果,旨在帮助人类解决各种问题,如提高生产效率、改善医疗诊断、优化交通管理等。例如,在医疗领域,AI辅助的影像诊断系统可以帮助医生更快速、准确地检测疾病,拯救患者生命。

- 所谓的“魔鬼”形象更多是源于人们对AI潜在风险的担忧被过度放大。像人们担心AI会取代人类工作,但从历史发展看,新技术出现时往往会创造新的就业机会,尽管就业结构会发生变化。

不是神器

- 虽然AI有很多强大的功能,但它也有局限性。AI系统的性能取决于其算法、数据和计算资源。目前,AI还无法像人类一样拥有真正的情感、意识和创造力(至少在通用人工智能尚未实现的当下)。例如,在艺术创作方面,AI创作的作品虽然可以在一定程度上模仿人类创作风格,但缺乏人类创作者的内在情感体验和独特的灵感来源。

二、面对AI产生的海量垃圾内容的应对方法

技术层面

- 内容筛选和过滤技术

- 开发更加智能的算法来识别和过滤垃圾内容。例如,利用自然语言处理技术分析文本内容的语义、逻辑结构等特征,将低质量、虚假或有害的内容筛选出来。对于图像和视频内容,可以采用图像识别和视频分析技术,识别其中包含的不良信息。

- 建立内容质量评估模型,通过机器学习算法学习高质量内容的特征,然后将新产生的内容与之进行对比,从而判断内容的价值。

- 数据管理改进

- 规范AI的数据来源,确保数据的准确性和可靠性。如果AI是基于大量低质量、不准确的数据进行训练,就容易产生垃圾内容。例如,在训练文本生成AI时,要对输入的文本数据进行严格筛选,去除那些语法错误严重、语义模糊或存在虚假信息的文本。

用户层面

- 提高媒介素养

- 教育用户如何辨别AI生成的垃圾内容。用户需要了解AI的工作原理和局限性,以便能够批判性地看待AI生成的内容。例如,在阅读新闻时,如果发现内容逻辑不连贯、来源不明且有明显的宣传倾向,就要警惕可能是AI生成的低质量内容。

- 培养用户的信息验证习惯,不轻易相信和传播未经证实的AI生成内容。鼓励用户通过多渠道验证信息的真实性,如查阅权威资料、咨询专家等。

社会层面

- 监管和规范

- 政府和相关机构应制定法律法规来规范AI内容的生成和传播。明确AI开发者和使用者的责任,对于故意生成和传播垃圾内容的行为进行处罚。例如,在网络平台上,要求对AI生成的内容进行标注,以便用户识别;同时,对传播有害AI生成内容的行为设定相应的法律责任。

- 建立行业标准,促使AI开发者遵循一定的内容质量准则。例如,要求AI在生成内容时遵循基本的道德、伦理和事实准确性原则。

- 公共讨论和教育

- 开展关于AI与垃圾内容问题的公共讨论,提高社会对这一问题的关注度。通过公众的参与和讨论,可以促使各方共同寻找解决方案。

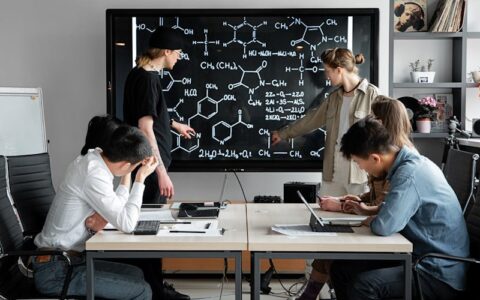

- 在学校和社会教育中增加关于AI内容管理的课程或培训内容,提高整个社会对AI内容的管理能力。

所以,不应该简单地放弃使用AI,而是要通过多种方式来管理和改善AI的使用,减少垃圾内容的产生和影响。

免费文章,允许转载!转载时请注明来源:【小钉教科】(xdjk.cn)

支持原创、保护作者权益、激发创作动力。